LOS ÁNGELES—Judy Rogg había esperado años este momento. A finales de febrero, un ejecutivo de YouTube subió al estrado en un juicio histórico sobre la adicción a las redes sociales en Los Ángeles, el primero en examinar si las empresas tecnológicas podían ser consideradas responsables del diseño y el funcionamiento de sus plataformas y del daño psicológico resultante para los niños.

Para los padres que han perdido a sus hijos por muertes accidentales o suicidios que, según ellos, fueron causados o facilitados por las redes sociales, fue un momento decisivo y emotivo. ¿Cómo responderían los líderes de las empresas de redes sociales más poderosas del mundo a las acusaciones de que conocían los riesgos, pero se dirigían a los jóvenes de todos modos?

Rogg, que ahora tiene más de 70 años, era un poco mayor que los demás padres que asistían asiduamente al juicio. Llevaba un gran pin con la imagen de su hijo, Erik: pecoso, con 12 años para siempre, sus brillantes ojos azules reflejando los de su madre. Lo perdió en 2010 después de que él intentara un reto del "juego de la asfixia", también conocido como "reto del desmayo", en el que los jóvenes intentan alcanzar un breve subidón hiperventilando o utilizando ligaduras para cortar el suministro de oxígeno hasta desmayarse.

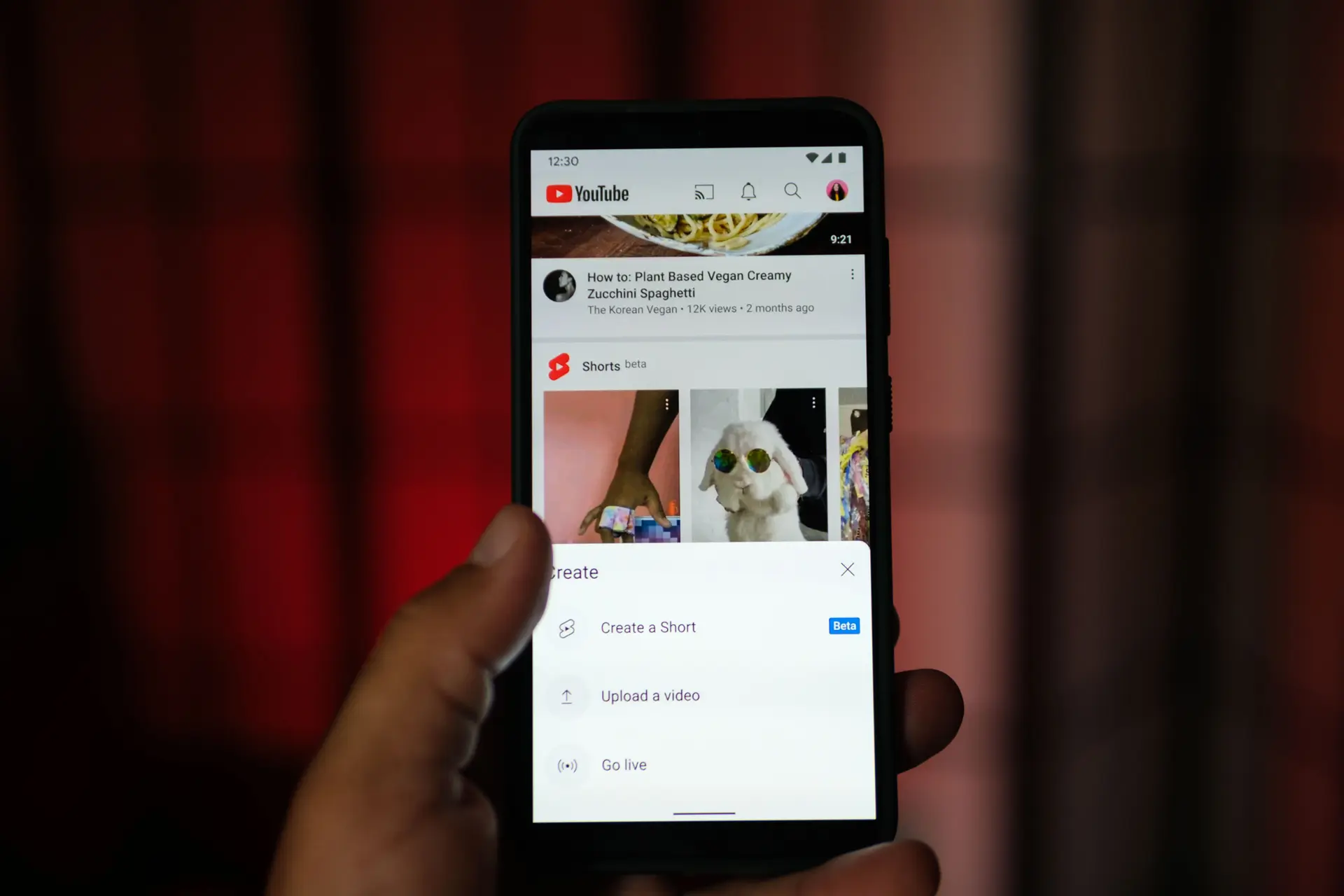

Estos juegos son anteriores a Internet, pero los algoritmos y las publicaciones imitativas en plataformas como YouTube y TikTok han amplificado exponencialmente su alcance, globalizando lo que antes era un reto adolescente localizado.

Ambas empresas prohíben los retos peligrosos y se han vuelto más proactivas a la hora de eliminarlos, y ambas utilizan la IA para detectar y eliminar cuentas de menores. Los ejecutivos llevan años diciendo que no encuentran pruebas de los retos de asfixia, llegando incluso a sugerir que muchas tendencias virales son, de hecho, "engaños" alimentados por los medios de comunicación y el pánico moral.

Y, sin embargo, los niños siguen muriendo tras ver estos vídeos en sus aplicaciones.

Mientras observaba cómo un abogado de la parte demandante en el juicio de Los Ángeles interrogaba a Cristos Goodrow, vicepresidente de ingeniería de YouTube, el 23 de febrero, Rogg dijo que se sentía reivindicada por los documentos internos que pintaban un panorama condenatorio del enfoque de la empresa respecto a la seguridad, y por una cronología que coincidía con su propia investigación sobre la circulación de vídeos del juego de la asfixia en YouTube.

Durante un descanso, salió de la sala de la corte y encontró un mensaje en su teléfono: un amigo de la familia de otra posible víctima del juego de la asfixia, esta vez un chico de 15 años, acababa de ponerse en contacto con ella.

"Se me detiene el corazón y se me revuelve el estómago, porque, por desgracia, es lo mismo", declaró Rogg a The Epoch Times.

Judy Rogg sostiene una foto de su difunto hijo Erik en Los Ángeles el 15 de abril de 2026. Erik murió en 2010 después de intentar un desafío “de juego de asfixia”, en el que los participantes buscan un breve subidón cortando el oxígeno hasta desmayarse. (John Fredricks/The Epoch Times)

Judy Rogg sostiene una foto de su difunto hijo Erik en Los Ángeles el 15 de abril de 2026. Erik murió en 2010 después de intentar un desafío “de juego de asfixia”, en el que los participantes buscan un breve subidón cortando el oxígeno hasta desmayarse. (John Fredricks/The Epoch Times)Esa familia aún no ha hecho pública su historia —a veces los padres tardan años en hablar de su experiencia, y la mayoría de las muertes por el juego de la asfixia se califican erróneamente como suicidios, según Rogg, quien lleva un recuento informal a través de su organización de defensa, Erik’s Cause.

"Es tan indignante que ni siquiera puedes comprenderlo y, en cierto modo, te tapas los ojos metafóricamente porque simplemente no puedes mirarlo. En cambio, en el caso del suicidio, en términos generales, hay señales", dijo.

Desde 2007, año en que se presentó el iPhone, Rogg contabiliza unas 741 muertes, la gran mayoría de ellas de niños en Estados Unidos.

Mientras el juicio daba comienzo en Los Ángeles el 9 de febrero, unos padres en Stephenville, Texas, a unos 2000 kilómetros de distancia, lloraban la repentina pérdida de su hija de 9 años.

El 3 de febrero, Curtis y Wendi Blackwell encontraron a su hija, JackLynn, inconsciente en el jardín trasero de su casa, con una cuerda enrollada alrededor del cuello. Según contaron a los medios, tras ver vídeos en YouTube, ella había intentado el "reto del desmayo".

Al igual que "Kaley G.M.", la demandante de 20 años del juicio de Los Ángeles, JackLynn llevaba desde muy joven utilizando YouTube con frecuencia. Los usuarios menores de 13 años no pueden registrarse para obtener una cuenta "principal" de YouTube; en su lugar, se les redirige a una versión restringida. Pero cualquiera puede ver los vídeos sin tener una cuenta o, como hizo Kaley, simplemente introducir una fecha de nacimiento aleatoria.

"Estaba mucho en YouTube, como, por supuesto, muchos niños", declaró Curtis Blackwell a un reportero de CBS en una emotiva entrevista televisiva en marzo.

Un hombre sostiene un teléfono que muestra la aplicación de YouTube en esta foto de archivo. Los algoritmos y el intercambio viral en plataformas como YouTube y TikTok han amplificado el alcance del desafío “juego de asfixia”, convirtiendo un desafío que alguna vez estuvo localizado en una tendencia global. (Oleksii Pydsosonnii/The Epoch Times)

Un hombre sostiene un teléfono que muestra la aplicación de YouTube en esta foto de archivo. Los algoritmos y el intercambio viral en plataformas como YouTube y TikTok han amplificado el alcance del desafío “juego de asfixia”, convirtiendo un desafío que alguna vez estuvo localizado en una tendencia global. (Oleksii Pydsosonnii/The Epoch Times)Muchos retos peligrosos parecieron alcanzar su punto álgido durante la pandemia en 2020 y 2021, y las muertes por el juego de la asfixia han disminuido significativamente desde entonces, según el recuento de Rogg. Pero su popularidad tiende a ser de naturaleza cíclica, resurgiendo de repente y luego volviendo a remitir.

Impulsada por un insaciable afán de viralidad, la antigua fascinación por la asfixia puede adoptar nuevas formas a medida que evolucionan las redes sociales.

A principios de este mes, los vídeos en los que se veía al popular influencer de la Generación Z Clavicular siendo estrangulado, perdiendo el conocimiento y sufriendo convulsiones durante una retransmisión en directo se hicieron, en sus propias palabras, "supervirales", lo que a su vez generó un sinfín de comentarios y vídeos inspirados en ellos, que se difundieron por YouTube, TikTok y otras plataformas.

6 de la tarde

Cada día, Annie McGrath pone un temporizador. A las 6 de la tarde, busca vídeos del juego de la asfixia en YouTube y denuncia los resultados a través del sistema online de la empresa.El hijo de McGrath, Griffin —conocido por sus seres queridos como Bubba— murió tras intentar un reto de desmayo en 2018. Tenía 13 años.

Los padres sobrevivientes escuchan cómo un abogado habla con la prensa durante un juicio histórico por adicción a las redes sociales frente a la Corte Superior de Los Ángeles el 18 de febrero de 2026. (Jill Connelly/Getty Images)

Los padres sobrevivientes escuchan cómo un abogado habla con la prensa durante un juicio histórico por adicción a las redes sociales frente a la Corte Superior de Los Ángeles el 18 de febrero de 2026. (Jill Connelly/Getty Images)"Ni siquiera estaba en las redes sociales; tuvo un teléfono plegable hasta los 13 años. Entonces, por fin le dimos [un smartphone]; lo quería porque era un cubista de Rubik’s Cube de velocidad", explicó McGrath a The Epoch Times. "Solo echaba un vistazo a YouTube de vez en cuando para ver a otros jugadores. Su mejor tiempo era de 8.7 segundos... Pensábamos que era inofensivo".

Desde su muerte, McGrath dijo: "He estado encontrando a niños todos los días en YouTube asfixiándose activamente. Todavía hay algunos que ya denuncié hace seis años".

Cuando los denuncia, recibe un mensaje automático indicando que la empresa eliminará el vídeo si incumple las normas de la comunidad.

Las frustraciones diarias de McGrath en 2023 se convirtieron en el objeto de una demanda federal por responsabilidad por productos defectuosos, en la que ella y otras madres alegaron que YouTube y TikTok diseñaron sistemas de moderación de contenidos defectuosos que no eliminaban los retos peligrosos.

"Este caso trata sobre cómo las empresas de redes sociales ignoran las denuncias fundamentales de padres que, de forma voluntaria, denuncian vídeos perjudiciales en Internet con el fin de evitar que otros niños sufran daños en el futuro", declaró Juyoun Han, abogada de los demandantes, a The Epoch Times.

Los sistemas de denuncia de las empresas, dijo, están diseñados para ser de difícil acceso y no se revisan ni se responde a ellos como debería, "prometiendo protección pero fallando cuando más importa". Lo comparó con una línea de emergencias que "desconecta más del 95 % de las llamadas o le dice erróneamente a la persona que llama que no se trata de una emergencia".

Un juez federal desestimó el caso, dictaminando que los demandantes no lograron identificar ninguna obligación por parte de los demandados independiente de su papel como editores de contenido de terceros, que está ampliamente protegido frente a reclamaciones por responsabilidad civil y negligencia por la Primera Enmienda y la Sección 230 de la Ley de Decencia en las Comunicaciones.

Cristos Goodrow (izq.), vicepresidente de ingeniería de YouTube, llega a la Corte Suprema de Los Ángeles para un juicio que examina si las empresas de redes sociales diseñaron sus plataformas para que fueran adictivas para los niños en Los Ángeles el 23 de febrero de 2026. (Frederic J. Brown/AFP vía Getty Images)

Cristos Goodrow (izq.), vicepresidente de ingeniería de YouTube, llega a la Corte Suprema de Los Ángeles para un juicio que examina si las empresas de redes sociales diseñaron sus plataformas para que fueran adictivas para los niños en Los Ángeles el 23 de febrero de 2026. (Frederic J. Brown/AFP vía Getty Images)Han dijo que tiene previsto presentar un recurso ante el Noveno Circuito este mes.

"Creemos que la corte ha malinterpretado nuestro argumento. La obligación es muy sencilla: representar y crear un sistema de denuncia que funcione tal y como se ha presentado y diseñado", declaró Han.

"Declaramos claramente que las empresas que prometen sistemas de seguridad específicos deben rendir cuentas cuando dichos sistemas fallan estrepitosamente. Esto no tiene nada que ver con la Sección 230 ni con la moderación de contenidos".

Aunque la Sección 230 ha proporcionado históricamente un escudo legal a prueba de balas, las decisiones recientes lo están socavando, incluyendo veredictos históricos en el caso de Kaley y en un caso presentado por Nuevo México en el que un jurado determinó el mes pasado que Meta era responsable de engañar a los consumidores sobre la seguridad de sus plataformas y de poner en peligro a los niños.

En 2024, una corte de apelaciones de EE. UU. revocó una desestimación previa de una demanda por homicidio culposo presentada contra TikTok por la madre de una víctima de 10 años del blackout challenge (reto del apagón), dictaminando que el uso por parte de la empresa de un algoritmo para recomendar contenido a los niños puede considerarse expresión propia y, por lo tanto, estar sujeto a responsabilidad.

Un portavoz de YouTube dijo que la empresa no podía comentar sobre litigios en curso. TikTok no respondió a las consultas sobre el caso.

En junio de 2023, McGrath fue invitada a exponer sus preocupaciones ante los accionistas de Alphabet, la empresa matriz de YouTube y Google.

"Tenían una [respuesta] pregrabada que decía: 'Lamentamos mucho su pérdida. No encontramos ningún reto de desmayo y, si lo hacemos, lo eliminamos'", dijo.

Familiares de víctimas se encuentran afuera de la Corte Suprema de Los Ángeles sosteniendo retratos de sus seres queridos en Los Ángeles el 25 de marzo de 2026. Si bien la Sección 230 de la Ley de Decencia en las Comunicaciones históricamente ha proporcionado un escudo legal a prueba de balas para las plataformas de redes sociales, decisiones recientes la están socavando. Frederic J. (Brown/AFP vía Getty Images)

Familiares de víctimas se encuentran afuera de la Corte Suprema de Los Ángeles sosteniendo retratos de sus seres queridos en Los Ángeles el 25 de marzo de 2026. Si bien la Sección 230 de la Ley de Decencia en las Comunicaciones históricamente ha proporcionado un escudo legal a prueba de balas para las plataformas de redes sociales, decisiones recientes la están socavando. Frederic J. (Brown/AFP vía Getty Images)¿Engaño o daño?

En una audiencia ante un subcomité del Senado de EE. UU. en 2021, Michael Beckerman, entonces responsable de políticas públicas de TikTok, dijo a los legisladores que su empresa no había podido encontrar "ninguna prueba de un reto de apagón en TikTok".Según él, ese tipo de contenido infringiría las directrices de la empresa y sería eliminado si lo detectaran la IA o los moderadores humanos. Los informes de transparencia de entonces mostraban que más del 94 % del contenido infractor se eliminaba de forma proactiva, dijo.

Beckerman sugirió además que las noticias sobre esos "supuestos retos" en TikTok no eran más que rumores, sensacionalizados por los medios de comunicación y los políticos, pero que en realidad nunca llegaron a aparecer en la aplicación.

"Desviamos las búsquedas, bloqueamos contenido, eliminamos contenido", dijo. "Pero, por desgracia, algo que hemos visto recientemente son informes de prensa sobre supuestos retos que, cuando los verificadores de datos... los investigan, descubren que estos nunca existieron en TikTok en primer lugar y que, de hecho, eran bulos que se originaron en otras plataformas".

YouTube tampoco permite, de forma similar, contenidos que muestren comportamientos en los que adultos se expongan a sufrir lesiones graves o a la muerte, especialmente si se fomenta dicho comportamiento o si alguien que lo vea pudiera imitarlo. En concreto, prohíbe los "retos extremadamente peligrosos", incluidos los actos que entrañen riesgo de asfixia.

Michael Beckerman, vicepresidente y jefe de políticas públicas de TikTok, testifica ante una audiencia del subcomité del Senado sobre Protección al Consumidor, Seguridad de Productos y Seguridad de Datos en Washington el 26 de octubre de 2021. (Samuel Corum/Getty Images)

Michael Beckerman, vicepresidente y jefe de políticas públicas de TikTok, testifica ante una audiencia del subcomité del Senado sobre Protección al Consumidor, Seguridad de Productos y Seguridad de Datos en Washington el 26 de octubre de 2021. (Samuel Corum/Getty Images)Y, sin embargo, las búsquedas realizadas por The Epoch Times en abril encontraron numerosos ejemplos de vídeos de estrangulamiento, asfixia y desmayos en YouTube. Al buscar con nombres de retos populares, ligeramente modificados para eludir las prohibiciones del sitio, aparecieron innumerables vídeos de adolescentes hiperventilando y desmayándose, con o sin amigos presionándoles las arterias carótidas, y estrangulándose unos a otros hasta perder el conocimiento.

Las búsquedas en TikTok arrojaron resultados similares. Ambas plataformas cuentan ahora con una serie de vídeos de advertencia que aparecen en la parte superior de los resultados de búsqueda.

Ninguna de las dos empresas respondió a las preguntas sobre vídeos específicos que parecen infringir las directrices de la comunidad pero que siguen en el sitio.

YouTube eliminó más de 8 millones de vídeos por infringir sus directrices de la comunidad entre octubre y diciembre de 2025, el último periodo sobre el que ofrece datos. La gran mayoría, el 64 %, se retiró por motivos de seguridad infantil.

La empresa sugiere que, incluso cuando los vídeos infractores no se retiran de inmediato, no se ven mucho, con una tasa de visualización de solo alrededor del 0.15 %.

Un hombre sostiene un teléfono que muestra la aplicación TikTok en esta foto de archivo. Alrededor del 63 por ciento de los adolescentes estadounidenses utilizan TikTok, según el Pew Research Center. (Oleksii Pydsosonnii/The Epoch Times)

Un hombre sostiene un teléfono que muestra la aplicación TikTok en esta foto de archivo. Alrededor del 63 por ciento de los adolescentes estadounidenses utilizan TikTok, según el Pew Research Center. (Oleksii Pydsosonnii/The Epoch Times)"La punta del iceberg"

Los datos de Rogg, que se basan en informes personales de familias de todo el mundo y no han sido verificados de forma independiente, muestran que las muertes por juegos de asfixia han descendido a solo unas 78 desde 2020."Me creo lo que dicen. No se lo están inventando", dijo Rogg.

Pero cree que el verdadero impacto está oculto a plena vista.

"Si alguien analizara realmente las cifras de muertes por asfixia entre preadolescentes y adolescentes dentro de las estadísticas de suicidios y realizara autopsias psicológicas de los casos, creo que se quedaría impactado", dijo.

Aunque los datos de los CDC sobre muertes por juegos de asfixia no se han actualizado desde 2007, la agencia realiza encuestas a adolescentes cada dos años a través de su Encuesta sobre Conductas de Riesgo en los Jóvenes. A través de su organización, Rogg consiguió que se añadiera una pregunta relevante a un suplemento opcional de la encuesta que un estado o distrito escolar puede solicitar, pero los CDC no publican los resultados a nivel nacional.

The Epoch Times presentó múltiples solicitudes a los CDC para obtener datos e información adicionales, pero no recibió respuesta.

Rogg se ha convertido en un punto de referencia para las familias en duelo, que no están seguras de lo que han vivido y buscan respuestas. Su propia historia refleja esta incertidumbre.

Erik era un "chico feliz y equilibrado", dijo Rogg. Activo en los Boy Scouts y en la liga infantil, estaba ilusionado y comprometido con su futuro. Esperaba ir a West Point cuando cumpliera 18 años e incluso envió un correo electrónico a su departamento de admisiones para asegurarse de que podría cumplir con sus requisitos físicos.

(Izquierda) Judy Rogg sostiene una de las pelotas de béisbol utilizadas y escritas por su hijo fallecido Erik en Los Ángeles el 15 de abril de 2026. (Derecha) Una foto de Erik Robinson junto a artículos que poseía en Los Ángeles el 15 de abril de 2026. (John Fredricks/The Epoch Time)

(Izquierda) Judy Rogg sostiene una de las pelotas de béisbol utilizadas y escritas por su hijo fallecido Erik en Los Ángeles el 15 de abril de 2026. (Derecha) Una foto de Erik Robinson junto a artículos que poseía en Los Ángeles el 15 de abril de 2026. (John Fredricks/The Epoch Time)"A los 12 años, con 36 kilos de peso empapado y vestido, era capaz de hacer una docena de dominadas. Trabajaba para alcanzar sus metas", dijo.

En el fondo, Rogg sabía que Erik no quería quitarse la vida.

Mientras esperaba junto a su cama, donde permanecía conectado a un respirador artificial tras el incidente, se presentaron dos detectives para decirle: "Esto no fue un suicidio. Fue un juego de asfixia".

Finalmente, algunos compañeros de clase se atrevieron a contarle que los vídeos de YouTube sobre ese juego circulaban ampliamente entre los de su curso, y que se había visto a él y a otro chico practicando cómo asfixiarse mutuamente. Aun así, no tiene pruebas de dónde lo aprendió Erik.

"La mayoría de las muertes por el juego de la asfixia se clasifican erróneamente como suicidios. Los forenses y los detectives no están capacitados para entender la diferencia. Entran, les parece un suicidio, marcan una casilla y se van", dijo, señalando que a los padres a menudo les cuesta cambiar el certificado de defunción a posteriori. "Esto deja a los padres en una doble encrucijada: '¿Qué señales no vi? ¿Qué mal padre soy?'. No eran malos padres. Es solo que no había nadie a quien hablarle de ello".

McGrath dijo que la mayoría de los padres no saben lo que pasó, o no tienen acceso a los teléfonos de sus hijos, por lo que asumen que su hijo se suicidó a propósito.

Los casos documentados, dijo, son "la punta del iceberg".

Judy Rogg sostiene una pelota de béisbol y un guante utilizados por su difunto hijo Erik en Los Ángeles el 15 de abril de 2026. (John Fredricks/The Epoch Times)

Judy Rogg sostiene una pelota de béisbol y un guante utilizados por su difunto hijo Erik en Los Ángeles el 15 de abril de 2026. (John Fredricks/The Epoch Times)"Por favor, no estés muerto"

La policía se llevó el ordenador y el teléfono de Bubba, y se los devolvió a McGrath seis meses después. Cuando el mejor amigo del chico fue a visitarla, vio el teléfono e introdujo su contraseña."El último mensaje decía: 'Por favor, no te mueras'. Era de una de las niñas. Estaba enamorado de ella", dijo McGrath. Explicó que finalmente se enteró de que Bubba había estado hablando por FaceTime con dos compañeros de clase que le habían retado a probar el reto viral.

"¿Qué niño no haría algo por su primer amor?"

Las muertes por asfixia accidental siguen estando extremadamente estigmatizadas, incluso más que el suicidio, dijo Rogg, y los padres a menudo tienen dificultades para entender cómo su hijo inteligente y feliz podría ser vulnerable.

En el hospital, recuerda haberle dicho a los detectives: "Es demasiado inteligente para algo tan estúpido".

Los investigadores han atribuido la fascinación de los adolescentes por los juegos que promueven las autolesiones al deseo de superar el miedo o buscar sensaciones intensas, incluida la sensación de poder tras sobrevivir a un reto potencialmente mortal, o de escapar de la realidad en momentos de frustración o ansiedad.

En los años transcurridos desde la muerte de Erik, los científicos se han alejado en gran medida de la idea de que el desarrollo del cerebro humano se detiene en la primera infancia, para pasar a entender que continúa hasta la adolescencia tardía y más allá.

La corteza prefrontal —responsable de la toma de decisiones, el control de los impulsos y la función ejecutiva— es una de las últimas regiones en desarrollarse. Hoy en día se acepta ampliamente que el proceso de maduración continúa hasta mediados de los veinte o incluso principios de los treinta.

Comprender esto, dijo Rogg, le ha ayudado a dar sentido a la tragedia imposible.

Judy Rogg se refleja en una ventana con una foto de ella y su difunto hijo Erik al fondo en Los Ángeles el 15 de abril de 2026. Rogg espera que las demandas y la legislación eventualmente conduzcan a cambios, pero cree que la educación es el eslabón perdido. ( John Fredricks/The Epoch Times)

Judy Rogg se refleja en una ventana con una foto de ella y su difunto hijo Erik al fondo en Los Ángeles el 15 de abril de 2026. Rogg espera que las demandas y la legislación eventualmente conduzcan a cambios, pero cree que la educación es el eslabón perdido. ( John Fredricks/The Epoch Times)Aumento de desafíos peligrosos

En 2009, un estudio publicado en la revista Clinical Pediatrics analizó vídeos de YouTube en los que aparecían adolescentes participando en "asfixia parcial recreativa", incluidos aquellos que provocaban convulsiones hipóxicas. Los autores llegaron a la conclusión de que la plataforma había permitido a millones de jóvenes ver vídeos del "juego de la asfixia" y corría el riesgo de normalizar ese comportamiento.Según el Pew Research Center, el 92 % de los adolescentes estadounidenses de entre 13 y 17 años utilizaba YouTube en 2025. El 68 % utiliza TikTok. En aquel momento, los 65 vídeos analizados tenían alrededor de 200,000 visualizaciones. En 2016, el mismo año en que YouTube alcanzó su objetivo de 1000 millones de horas de visualización diarias, un estudio publicado en Global Pediatric Health ofreció una actualización, analizando más de 400 vídeos del "juego de la asfixia". Se descubrió que el contenido relacionado había aumentado en más de un 400 %, con vídeos vistos más de 22 millones de veces.

Una revisión exploratoria publicada en la revista Injury Epidemiology en 2025 reveló que el número de artículos que informaban de lesiones derivadas de retos peligrosos en las redes sociales comenzó a aumentar en 2021, pero los autores señalaron una "flagrante" falta de intervenciones implementadas.

Podría decirse que la migración de estos juegos a los espacios en línea los ha hecho más peligrosos, ya que los niños que los practican solos pueden correr un mayor riesgo de sufrir lesiones o incluso la muerte.

La gente mira sus teléfonos en el metro de Nueva York el 1 de abril de 2014. (Samira Bouaou/The Epoch Times)

La gente mira sus teléfonos en el metro de Nueva York el 1 de abril de 2014. (Samira Bouaou/The Epoch Times)Muchos retos de las redes sociales son inofensivos, y su popularidad entre los adolescentes es una extensión de la necesidad de pertenencia social, reconocimiento, desarrollo de la identidad y expresión. Sin embargo, se sabe que los contenidos virales desencadenan emociones intensas, tanto positivas como negativas, lo que a menudo empuja a los usuarios hacia comportamientos más extremos.

Los niños que han sido preparados de forma innata por YouTube para convertirse en youtubers pueden verse impulsados a crear contenidos cada vez más espectaculares en su afán por mantener una audiencia, escribieron los autores de un estudio de 2020 publicado en la revista en español Salud Colectiva. El estudio examinó las autolesiones provocadas por los retos en línea en Brasil, donde los investigadores habían observado en 2017 una proliferación igualmente dramática en el número y la variedad de vídeos del juego de la asfixia.

El antropólogo y sociólogo francés David Le Breton ha sugerido que los juegos de asfixia y desmayo en línea pueden funcionar como una especie de sustituto de los ritos de paso comunitarios, culturales o religiosos perdidos.

Estos juegos son transgresores y tabúes, pero no en el sentido en que lo son las drogas: ofrecen "una forma fácil de acceder a un estado alterado de conciencia, cuyo valor se ve potenciado por su naturaleza oculta.

Esa naturaleza continúa en Internet con un léxico en constante cambio de términos de búsqueda, hashtags y grafías alternativas que los niños inventan sin esfuerzo para burlar a los censores y ocultar sus juegos a plena vista.

La lectura de pulseras “Stop Online Harm” promueve el mensaje de Erik's Cause, una organización sin fines de lucro que lleva el nombre del hijo de Rogg, Erik, en Los Ángeles el 15 de abril de 2026. (John Fredricks/The Epoch Times)

La lectura de pulseras “Stop Online Harm” promueve el mensaje de Erik's Cause, una organización sin fines de lucro que lleva el nombre del hijo de Rogg, Erik, en Los Ángeles el 15 de abril de 2026. (John Fredricks/The Epoch Times)Culpar a los padres

Los padres que han perdido a sus hijos por suicidio, sobredosis o muertes accidentales que relacionan con las redes sociales dicen que existe un mito generalizado de que estas tragedias solo afectan a niños con problemas o a hijos de malos padres.Joann Bogard, codemandante junto a McGrath en la demanda federal contra YouTube y TikTok, dijo que utilizó todas las herramientas disponibles para supervisar el uso que su hijo hacía de las redes sociales.

A los 15 años, su hijo Mason era un chico feliz, ingenioso y "amante de la naturaleza" al que le encantaba acampar, pescar y hacer senderismo. Tenía buenos amigos, iba a un buen colegio. Quería estar en YouTube para ver vídeos sobre cómo fabricar un mejor señuelo de pesca o perfeccionar sus habilidades en carpintería, dijo ella.

"Tenía todos los ajustes, tenía las aplicaciones de control, revisaba sus dispositivos. Hice todo lo que los expertos me dijeron que hiciera", dijo Bogard. "En 2019, el algoritmo de YouTube le mostró el reto de la asfixia sin que lo pidiera. Mason lo probó y le resultó fatal".

Tanto Bogard como McGrath son destacadas activistas que, con el apoyo de otros padres, han logrado sentirse lo suficientemente cómodas como para compartir sus tragedias personales con el público. Pero la reacción puede ser brutal.

"Recibo los comentarios más duros", dijo McGrath sobre su reciente aparición en un podcast. "Dicen: 'La supervivencia del más apto, la teoría de Darwin, no culpes a YouTube porque tu hijo es un idiota' ". Son comentarios realmente duros, y culpan a los padres.

La gente piensa: “Mi hijo nunca haría algo tan estúpido”.

Joann Bogard sostiene una foto de ella con su hijo, Mason, en el Tribunal Superior de Los Ángeles el 5 de febrero de 2026. Mason murió a los 15 años en 2019 después de intentar un desafío viral “de asfixia” en YouTube. (Cortesía de Joann Bogard)

Joann Bogard sostiene una foto de ella con su hijo, Mason, en el Tribunal Superior de Los Ángeles el 5 de febrero de 2026. Mason murió a los 15 años en 2019 después de intentar un desafío viral “de asfixia” en YouTube. (Cortesía de Joann Bogard)Seguridad infantil frente a libertad de expresión

Padres como McGrath, Bogard y Rogg esperan que la próxima oleada de litigios obligue a las empresas tecnológicas a cambiar su forma de operar y a dar prioridad a la seguridad de los usuarios jóvenes.Pero consideran que la mejor oportunidad para lograr un cambio sustancial es la Ley de Seguridad Infantil en Internet (KOSA), una legislación federal que impondría a las plataformas un "deber de diligencia" para mitigar los daños a adolescentes y niños, controlar el impacto de las recomendaciones algorítmicas y las funciones adictivas, y dar a los padres controles adicionales.

También agilizaría los sistemas de denuncia que, según McGrath y Bogard, son defectuosos, y exigiría auditorías anuales realizadas por terceros e informes públicos.

Los críticos, por su parte, advierten que este tipo de leyes abrirán la puerta a la vigilancia y la censura sancionadas por el Estado, lo que supondrá el fin del anonimato en línea y de la libertad en Internet tal y como la conocemos.

"El lenguaje excesivamente amplio de la KOSA y de legislaciones similares corre el riesgo de censurar todo, desde chistes y exageraciones hasta información útil sobre educación sexual y prevención del suicidio", dijo Jenna Leventoff, asesora jurídica sénior de la Unión Americana por las Libertades Civiles, en una declaración el año pasado.

Tal y como argumenta la Fundación para los Derechos Individuales y la Expresión (FIRE), el mandato impreciso de la KOSA de mitigar el daño causado por las "características de diseño" dejaría la puerta abierta a futuras interpretaciones por parte de la Comisión Federal de Comercio, que haría cumplir el deber de diligencia; las cortes; los 50 fiscales generales estatales; y las propias plataformas.

El representante Gus Bilirakis (republicano de Florida) habla durante una manifestación celebrada en apoyo de la Ley de Seguridad Infantil en Línea en el Capitolio en Washington el 10 de diciembre de 2024. (Jemal Countess/Getty Images para tecnología responsable)

El representante Gus Bilirakis (republicano de Florida) habla durante una manifestación celebrada en apoyo de la Ley de Seguridad Infantil en Línea en el Capitolio en Washington el 10 de diciembre de 2024. (Jemal Countess/Getty Images para tecnología responsable)Estos mandatos, argumenta la organización, "dejarían una espada regulatoria de Damocles sobre las plataformas de redes sociales", lo que conduciría a una censura preventiva, según sople el viento político en cada momento.

Los defensores de la legislación replican que el "deber de diligencia" solo se aplicaría a un conjunto fijo y claramente establecido de daños —"trastornos de salud mental reconocidos médicamente", uso adictivo, drogas ilícitas, explotación sexual infantil según la definición federal y suicidio— y que la FTC no puede añadir ni modificar los daños cubiertos por el proyecto de ley. Además, afirman que la KOSA no hará responsables a las plataformas por los contenidos que alojen o eliminen, ni por proporcionar contenidos a los usuarios jóvenes cuando estos los busquen.

Presentada por primera vez en 2022 por el senador Richard Blumenthal (D-Conn.) y la senadora Marsha Blackburn (R-Tenn.), la KOSA se ha incorporado desde entonces a un paquete más amplio que salió adelante en una subcomisión de la Cámara de Representantes en marzo, pero se enfrenta a un futuro incierto en el Senado, ya que los legisladores discrepan sobre las versiones del proyecto de ley.

Mientras tanto, los detractores de la versión de la Cámara de Representantes, entre ellos la Asociación Nacional de Fiscales Generales, sostienen que obstaculizaría la capacidad de los estados para hacer frente a los daños en línea y vacía de contenido el eje central de la KOSA: el deber de diligencia.

A medida que continúa la lucha por encontrar un nuevo equilibrio entre la seguridad en línea y la libertad de expresión, se espera que muchas de las cuestiones que se están litigando actualmente acaben llegando a la Corte Suprema.

En 2025, la Corte, en una decisión de 6 a 3, confirmó una ley de Texas que exige a los sitios web cuyo contenido esté compuesto al menos en un tercio por "contenido sexual perjudicial para menores" que recopilen información de verificación de edad de todos los usuarios.

Un niño mira la pantalla de su iPad con la aplicación YouTube Kids abierta en Sydney el 7 de diciembre de 2025. (George Chan/Getty Images)

Un niño mira la pantalla de su iPad con la aplicación YouTube Kids abierta en Sydney el 7 de diciembre de 2025. (George Chan/Getty Images)La sentencia, según críticos como la Electronic Frontier Foundation, "ignora las muchas formas en que verificar la edad en línea es significativamente más oneroso e invasivo" que mostrar un documento de identidad en una tienda. Exigir a todos los usuarios que faciliten un documento de identidad oficial "con gran cantidad de datos" dará lugar a una serie de "graves problemas de anonimato, privacidad y seguridad", argumenta la fundación en una crítica a la decisión de la corte. La verificación de la edad también amenaza el anonimato en línea, advierten los críticos. Incluso si las empresas no están obligadas por ley a aplicar controles de edad en sus plataformas, podrían verse obligadas, ante la amenaza de responsabilidad civil, a implementar comprobaciones obligatorias de identidad o escáneres biométricos.

La Corte Suprema ha defendido sistemáticamente el anonimato, incluido el anonimato en línea, como un "escudo contra la tiranía de la mayoría" protegido por la Constitución, tal y como escribió el juez John Paul Stevens en 1995.

Pero los límites de esa protección, y cómo se cruza con los esfuerzos para proteger a los menores de contenidos claramente perjudiciales, algoritmos depredadores y funciones adictivas, siguen evolucionando.

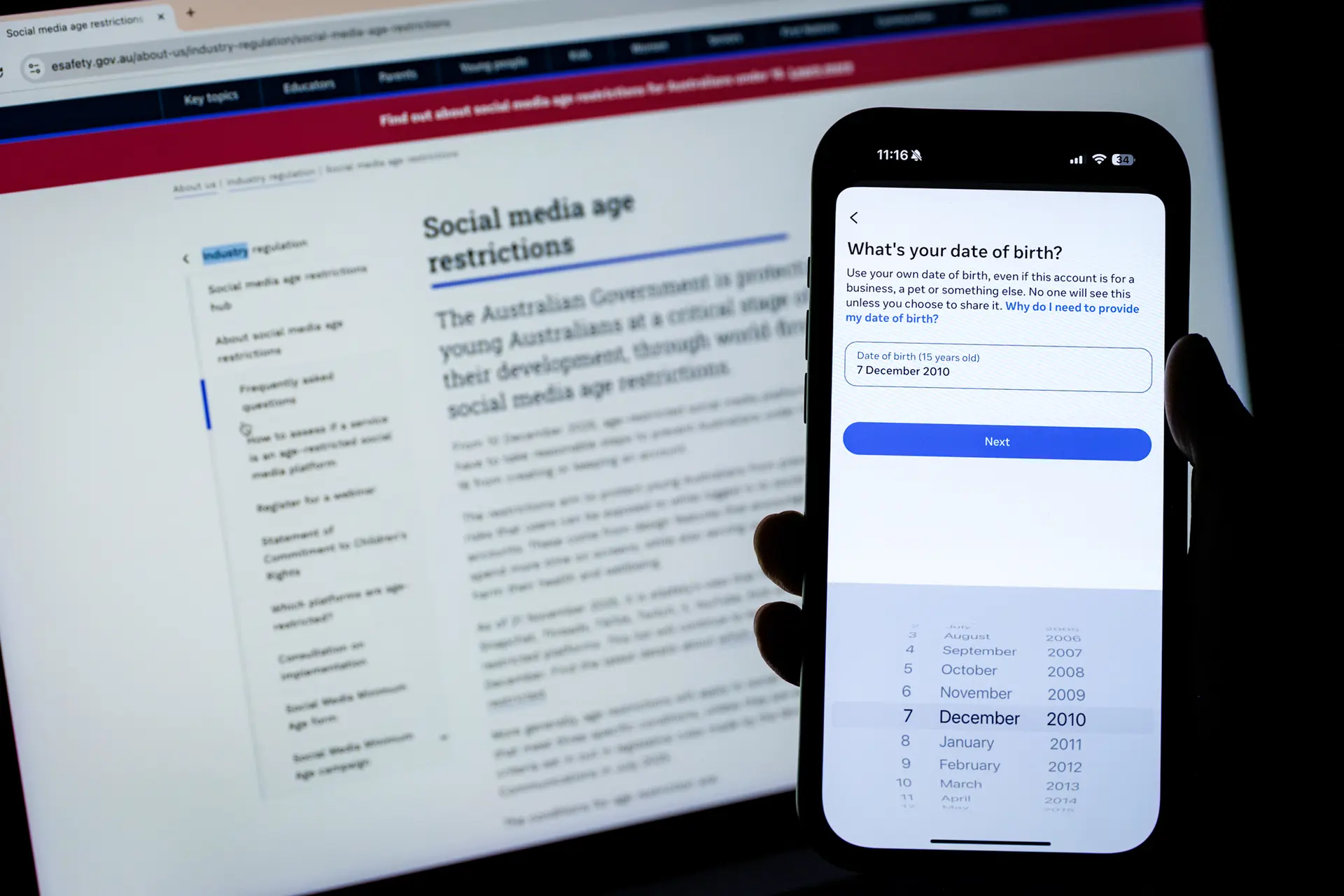

Tanto YouTube como TikTok han introducido mecanismos progresivos de verificación de edad en los últimos años, pero ninguna de las dos plataformas exige actualmente a todos los usuarios que verifiquen su edad mediante un documento de identidad o una evaluación biométrica para abrir una cuenta.

Si una cuenta es marcada como potencialmente perteneciente a un usuario menor de edad, en función de su actividad, es posible que se le pida a ese usuario que presente un documento de identidad oficial o un vídeo selfie para demostrar su edad o, en el caso de TikTok, desbloquear funciones como la transmisión en directo de la aplicación.

El sistema de TikTok marca las cuentas que sospecha que pertenecen a usuarios menores de 13 años. Para evitar la suspensión, un usuario marcado puede enviar una selfie con un documento de identidad o una tarjeta de crédito, o utilizar una tecnología de estimación de la edad facial de terceros.

La empresa ha dicho que elimina alrededor de 6 millones de cuentas sospechosas de pertenecer a menores cada mes.

En 2025, YouTube introdujo la IA para interpretar la actividad de las cuentas y estimar la edad de los usuarios. Si la empresa considera que un usuario es menor de 18 años, se activan automáticamente los ajustes para adolescentes y los usuarios tienen la opción de verificar su identidad con un documento de identidad oficial o una tarjeta de crédito.

En esta ilustración fotográfica, la página de creación de cuentas de Instagram se muestra en un teléfono en Sydney el 7 de diciembre de 2025. Tanto YouTube como TikTok han introducido mecanismos progresivos de verificación de edad en los últimos años—, pero actualmente ninguno requiere que todos los usuarios verifiquen su edad con identificación o evaluación biométrica para abrir una cuenta. (George Chan/Getty Images)

En esta ilustración fotográfica, la página de creación de cuentas de Instagram se muestra en un teléfono en Sydney el 7 de diciembre de 2025. Tanto YouTube como TikTok han introducido mecanismos progresivos de verificación de edad en los últimos años—, pero actualmente ninguno requiere que todos los usuarios verifiquen su edad con identificación o evaluación biométrica para abrir una cuenta. (George Chan/Getty Images)La Corte Suprema ha defendido sistemáticamente el anonimato, incluido el anonimato en línea, como un "escudo contra la tiranía de la mayoría" protegido por la Constitución, tal y como escribió el juez John Paul Stevens en 1995.

Pero los límites de esa protección, y cómo se cruza con los esfuerzos por proteger a los menores de contenidos claramente perjudiciales, algoritmos depredadores y funciones adictivas, siguen evolucionando.

Tanto YouTube como TikTok han introducido mecanismos progresivos de verificación de edad en los últimos años, pero ninguna de las dos plataformas exige actualmente a todos los usuarios que verifiquen su edad mediante identificación o evaluación biométrica para abrir una cuenta.

Si una cuenta es marcada como potencialmente perteneciente a un usuario menor de edad, basándose en su actividad, se le puede exigir a ese usuario que presente un documento de identidad oficial o un vídeo selfie para demostrar su edad o, en el caso de TikTok, desbloquear funciones como la transmisión en directo de la aplicación.

El sistema de TikTok marca las cuentas que sospecha que pertenecen a usuarios menores de 13 años. Para evitar la suspensión, un usuario marcado puede enviar una selfie con un documento de identidad o una tarjeta de crédito, o utilizar una tecnología de estimación de la edad facial de terceros.

La empresa dijo que elimina alrededor de 6 millones de cuentas sospechosas de pertenecer a menores cada mes.

"Todavía no lo saben"

Rogg espera que las demandas y la legislación conduzcan finalmente a un cambio, pero cree que la educación es el eslabón perdido."Aunque consigamos que se aprueben las leyes, el proceso judicial se prolongará durante décadas... Las empresas seguirán recurriendo", dijo.

"Hay que llegar a los niños, las familias y las comunidades, porque siguen sin saberlo. Y volver a meter al genio en la lámpara, incluso si llevan a cabo todos estos cambios, va a llevar mucho tiempo".

Aunque las campañas de concienciación sobre el ciberacoso, el suicidio, la intoxicación por fentanilo y la sextorsión se han vuelto cada vez más comunes, señaló Rogg, no ha sido fácil llevar a las escuelas el programa de concienciación que desarrolló a través de Erik’s Cause.

"No estoy segura de que los distritos escolares comprendieran realmente lo importante que es todo este tema hasta que surgió la cuestión de la IA el año pasado", dijo Rogg.

Algunos estados han optado por un portal en línea, en lugar de una clase presencial, para enseñar seguridad en Internet.

"Esto es ir demasiado lejos para nosotros", dijo. "No crearemos un programa sobre seguridad en Internet impartido por un ordenador. Creo sinceramente que debe ser impartido por una persona real que pueda responder a las preguntas".

Algunas escuelas se resisten a que ponentes aborden el tema en el campus, por temor a la responsabilidad civil en caso de incidentes de imitación.

Rogg señala los resultados de encuestas realizadas en un distrito escolar de Utah entre 2016 y 2023 para argumentar que, allí donde ha aumentado la educación, "la curiosidad por jugar" estos juegos peligrosos ha disminuido.