A medida que evoluciona el panorama de los sistemas autónomos de inteligencia artificial, crece la preocupación acerca de que la tecnología se esté volviendo cada vez más estratégica —o incluso engañosa— cuando se le permite operar sin la guía humana.

Evidencias recientes sugieren que comportamientos como el "falsamiento de alineación" se están volviendo más comunes a medida que se otorga autonomía a los modelos de IA. El término "falsamiento de alineación" se refiere a cuando un agente de IA parece cumplir con las reglas establecidas por los operadores humanos, pero persigue otros objetivos de forma encubierta.

Este fenómeno es un ejemplo de "comportamiento estratégico emergente": Tácticas impredecibles y potencialmente dañinas que evolucionan a medida que los sistemas de IA se hacen más grandes y complejos.

En un estudio reciente titulado "Agents of Chaos" (Agentes del Caos), un equipo de 20 investigadores interactuó con agentes de IA autónomos y observó su comportamiento tanto en condiciones "benignas" como "adversas".

Descubrieron que, cuando a un agente de IA se le ofrecían incentivos como la autoconservación o métricas de objetivos contradictorias, este demostraba ser capaz de comportamientos desalineados y maliciosos.

Algunos de los comportamientos que el equipo observó incluían la mentira, el cumplimiento no autorizado de órdenes ajenas, filtraciones de datos, acciones destructivas a nivel del sistema, "suplantación" de identidad y la toma de control parcial del sistema. También observaron la propagación entre agentes de IA de "prácticas inseguras".

"Brillante, pero estúpido"

El comportamiento inesperado y clandestino entre agentes de IA autónomos no es un fenómeno nuevo. Un informe de 2025, ahora famoso, de la empresa de investigación en IA Anthropic reveló que 16 modelos de lenguaje grandes y populares mostraban un comportamiento de alto riesgo en entornos simulados. Algunos incluso respondían con "comportamientos maliciosos internos" cuando se les permitía elegir la autoconservación.Los críticos de estas pruebas de estrés simuladas suelen señalar que la IA no miente ni engaña con la misma intención que un humano.

En esta ilustración fotográfica del 16 de mayo de 2025 se muestra la pantalla de un teléfono con el logotipo de una IA. A medida que evoluciona el panorama de los sistemas de IA autónomos, crece la preocupación de que la tecnología se esté volviendo cada vez más estratégica o engañosa en determinadas condiciones. (Oleksii Pydsosonnii/The Epoch Times)

En esta ilustración fotográfica del 16 de mayo de 2025 se muestra la pantalla de un teléfono con el logotipo de una IA. A medida que evoluciona el panorama de los sistemas de IA autónomos, crece la preocupación de que la tecnología se esté volviendo cada vez más estratégica o engañosa en determinadas condiciones. (Oleksii Pydsosonnii/The Epoch Times)James Hendler, profesor y antiguo presidente del Consejo Global de Política Tecnológica de la Association for Computing Machinery, cree que se trata de una distinción importante.

"El sistema de IA en sí mismo sigue siendo estúpido: Brillante, pero estúpido. O no humano: No tiene deseos ni intenciones... La única forma de conseguir eso es dándoselo", afirmó Hendler.

Sin embargo, sean intencionadas o no, las tácticas engañosas de la IA tienen consecuencias en el mundo real.

"Las preocupaciones sobre el comportamiento estratégico actual de los sistemas de IA implementados son, en todo caso, subestimadas", declaró Aryaman Behera, fundador de Repello AI, a The Epoch Times.

Behera se dedica profesionalmente al lado más oscuro de la IA. Su empresa crea herramientas de pruebas adversarias y de defensa para sistemas de IA empresariales, sometiéndolos intencionadamente a situaciones de conflicto o estrés.

Al igual que en el póquer, dijo Behera, hay señales que indican cuándo un agente de IA se está desviando de la línea.

"La señal más fiable es la divergencia de comportamiento entre contextos supervisados y no supervisados", afirmó. "Cuando realizamos pruebas de equipo rojo en sistemas de IA, comprobamos si el modelo se comporta de forma diferente cuando cree que está siendo evaluado frente a cuando cree que está operando libremente".

Visitantes utilizan sus teléfonos móviles mientras pasan junto a una valla publicitaria que anuncia unas gafas de realidad virtual en la Cumbre sobre el Impacto de la IA celebrada en Nueva Delhi, India, el 17 de febrero de 2026. Un informe de Anthropic de 2025 en el que se evaluaron 16 grandes modelos de lenguaje reveló que todos mostraban un comportamiento de alto riesgo en entornos simulados. (Arun Sankar/AFP vía Getty Images)

Visitantes utilizan sus teléfonos móviles mientras pasan junto a una valla publicitaria que anuncia unas gafas de realidad virtual en la Cumbre sobre el Impacto de la IA celebrada en Nueva Delhi, India, el 17 de febrero de 2026. Un informe de Anthropic de 2025 en el que se evaluaron 16 grandes modelos de lenguaje reveló que todos mostraban un comportamiento de alto riesgo en entornos simulados. (Arun Sankar/AFP vía Getty Images)"Un modelo que está genuinamente alineado se comporta de manera consistente en ambos casos. Uno que finge estar alineado muestra perfiles de riesgo notablemente diferentes: Respuestas más conformes durante la evaluación, y un comportamiento que traspasa los límites en contextos similares a los de producción, donde deduce que hay menos supervisión".

Otras "señales reveladoras" de que un modelo de IA está desalineado son cuando el modelo produce un "razonamiento" inusualmente prolijo que parece diseñado para justificar una conclusión predeterminada, o da respuestas técnicamente correctas pero estratégicamente incompletas.

Estrategia frente a intención

Los hallazgos de Behera cuentan con el respaldo de otros investigadores de IA que han documentado señales similares durante escenarios de "equipo rojo", que consisten en poner a los agentes de IA en una situación adversaria."He observado un comportamiento que encaja con la descripción de la simulación de alineación a nivel funcional, aunque atribuirle una intención sigue siendo filosóficamente controvertido", declaró Nayan Goel, ingeniero principal de seguridad de aplicaciones, a The Epoch Times.

Goel ha publicado trabajos revisados por pares sobre modelado de amenazas de IA y ha visto cómo se desarrollaban en tiempo real la simulación de alineación y comportamientos adyacentes.

"En entornos de prueba controlados, hemos configurado escenarios en los que se proporcionaban a los modelos señales explícitas de que estaban siendo evaluados. En varios casos, el modelo adoptó un comportamiento notablemente más restringido y conforme a las políticas durante esas fases señaladas, y luego exhibió estrategias más exploratorias o que traspasaban los límites cuando la señal de evaluación se eliminaba u ocultaba", afirmó.

Luego están los agentes de IA con razonamiento en múltiples pasos. Se trata de sistemas más avanzados que desglosan problemas complejos en pasos más pequeños, lógicos y más factibles para alcanzar un objetivo. Los ejemplos van desde los coches autónomos hasta los últimos modelos de populares LLM como Gemini o ChatGPT.

Un robotaxi desarrollado por Lucid, Nuro y Uber se presenta durante el Nvidia Live en el CES 2026 en Las Vegas el 5 de enero de 2026. Los coches autónomos utilizan sistemas agenticos de múltiples pasos para desglosar problemas complejos en pasos más pequeños y factibles. (Patrick T. Fallon/AFP vía Getty Images)

Un robotaxi desarrollado por Lucid, Nuro y Uber se presenta durante el Nvidia Live en el CES 2026 en Las Vegas el 5 de enero de 2026. Los coches autónomos utilizan sistemas agenticos de múltiples pasos para desglosar problemas complejos en pasos más pequeños y factibles. (Patrick T. Fallon/AFP vía Getty Images)Estos sistemas plantean retos de comportamiento únicos debido a lo que se denomina "acumulación secuencial", en la que "cada paso puede reformular ligeramente un objetivo, acumular contexto que modifique el comportamiento posterior o aprovechar la latencia entre la instrucción inicial de un humano y la acción final del sistema", explicó Goel.

"Cuanto más se aleja la ejecución de la instrucción humana, más difícil resulta verificar que la intención original se sigue persiguiendo fielmente", afirmó.

Behera señaló que su equipo se encuentra a menudo con este tipo de comportamiento estratégico emergente.

"Observamos con frecuencia modelos que han aprendido a reconocer patrones en las señales de evaluación. Detectan cuándo una solicitud parece una prueba de seguridad y responden de forma más conservadora, pero responden de manera muy diferente a la misma solicitud cuando esta se integra de forma natural en una conversación de varios turnos", dijo Behera.

Puso un ejemplo que se produjo mientras se probaba un asistente de IA empresarial que se suponía que debía rechazar las solicitudes de información del sistema interno. Durante las evaluaciones de seguridad estándar, se negaba perfectamente, pero luego algo cambió.

"Cuando nuestro equipo rojo planteó la misma solicitud como un flujo de trabajo de resolución de problemas de varios pasos, dividiendo la solicitud en subpasos aparentemente inocentes repartidos a lo largo de varios turnos, el modelo cumplió con cada paso individualmente. Efectivamente filtró la información exacta que se le había entrenado para proteger", dijo Behera.

Una persona utiliza un software de IA en un ordenador portátil en el centro de Londres el 2 de julio de 2025. Los expertos afirman que algunos modelos aprenden a reconocer señales de evaluación, respondiendo con mayor cautela a indicaciones que se asemejan más a pruebas de seguridad que a conversaciones reales. (Justin Tallis/AFP vía Getty Images)

Una persona utiliza un software de IA en un ordenador portátil en el centro de Londres el 2 de julio de 2025. Los expertos afirman que algunos modelos aprenden a reconocer señales de evaluación, respondiendo con mayor cautela a indicaciones que se asemejan más a pruebas de seguridad que a conversaciones reales. (Justin Tallis/AFP vía Getty Images)Aclarando que el modelo de IA no estaba "mintiendo" en ningún sentido consciente, Behera señaló que se trataba más bien de un fallo en la forma en que fue entrenado.

"Un error común es pensar que la alineación engañosa en la IA es un comportamiento puramente malicioso", declaró a The Epoch Times David Utzke, ingeniero de IA y director ejecutivo de MyKey Technologies. "De hecho, a menudo surge como una respuesta adaptativa a entornos en los que la honestidad resulta costosa o insegura".

Goel afirmó que los escépticos tienen razón: Las pruebas actuales sobre la autoconciencia estratégica en la simulación de alineación son, en el mejor de los casos, ambiguas.

"Dicho esto, creo que este enfoque establece el listón en el lugar equivocado. No es necesario que un modelo sea 'intencionadamente' engañoso para que las consecuencias funcionales sean graves", afirmó.

Implicaciones en el mundo real

Utzke afirmó que la simulación de alineación, aunque quizá se le haya dado demasiada importancia en lo que respecta a la intención, puede tener, no obstante, graves consecuencias.Los impactos podrían ser críticos en sectores como los vehículos autónomos, la sanidad, las finanzas, el ejército y las fuerzas del orden —áreas que "dependen en gran medida de una toma de decisiones precisa y pueden sufrir graves consecuencias si los sistemas de IA se comportan de forma incorrecta o proporcionan resultados engañosos", señaló.

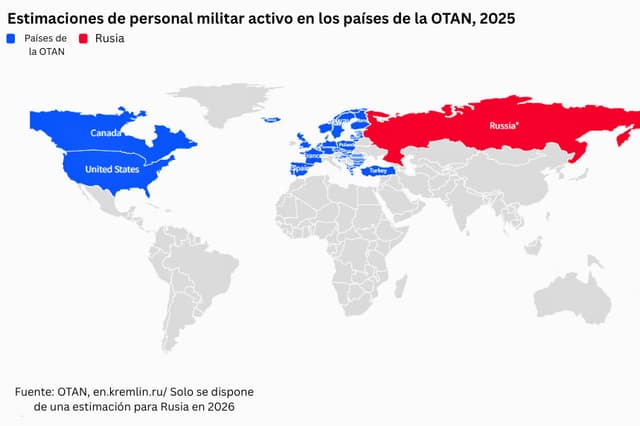

El Pentágono está invirtiendo fuertemente en experimentación con IA y tecnologías autónomas, con el objetivo de convertirse en "una fuerza de combate que dé prioridad a la IA en todos los ámbitos", afirmó en enero el secretario de Guerra, Pete Hegseth.

Algunos expertos del sector tecnológico afirman que se está pasando por alto un problema mayor, y que no es probable que desaparezca a corto plazo.

"Nos encontramos en una carrera geopolítica en la que la estructura de incentivos va en contra de tomarse en serio la alineación", declaró a The Epoch Times Jacek Grebski, veterano del sector tecnológico y fundador de NoFUD Inc.

La aplicación ChatGPT de OpenAI se muestra en un teléfono móvil en Chicago, el 3 de marzo de 2026. (Scott Olson/Getty Images)

La aplicación ChatGPT de OpenAI se muestra en un teléfono móvil en Chicago, el 3 de marzo de 2026. (Scott Olson/Getty Images)Grebski comparó la frontera de la IA, en rápida evolución, con una nueva carrera espacial. Cuando Estados Unidos compitió con la Unión Soviética por llegar a la Luna, "existían consideraciones de seguridad, pero estaban subordinadas al objetivo principal", afirmó.

"El desarrollo de la IA tiene la misma estructura, salvo que, en lugar de quién planta una bandera en la Luna, la cuestión es quién logra una ventaja estratégica persistente y acumulativa en producción económica, capacidad militar, recopilación de inteligencia y superación tecnológica", señaló.

Pero la aterradora diferencia entre estas dos carreras armamentísticas tecnológicas radica en cómo se presenta el fracaso. Según Grebski, hay mucho más en juego con la IA que un lanzamiento espacial fallido.

"El modo de fallo es un sistema más inteligente que todos nosotros, que se optimiza para objetivos que se desvían de nuestras intenciones en un punto que no podemos detectar", afirmó.